Tabla de Contenidos

Al analizar estadísticamente series de datos cuantitativos, muchas veces nos vemos frente a datos emparejados o pares ordenados. Estos corresponden a datos de dos variables distintas generalmente provenientes del mismo individuo y que, por tanto, están vinculados entre sí. Se trata entonces de datos que no se consideran por separado, sino que siempre se deben considerar juntos, como por ejemplo la estatura y el peso de un individuo particular, o el peso y la velocidad máxima de un automóvil.

Cuando tenemos datos emparejados, la estadística nos proporciona la posibilidad de establecer si existe una relación entre estas variables. Esto es particularmente común en las distintas ciencias, especialmente cuando se observa que el comportamiento de una variable parece afectar o determinar el comportamiento de otra. Al establecer estas relaciones, la estadística nos proporciona dos tipos diferentes de herramientas: los estudios de correlación entre dos o más variables y el ajuste de datos emparejados a distintos modelos matemáticos por medio de un proceso de regresión.

En el caso de los datos que se comportan de manera lineal, se puede calcular un coeficiente de regresión lineal, r, que mide qué tan linealmente se comportan los datos. Por otro lado, se puede obtener también la ecuación matemática de la línea recta que mejor se ajusta a los datos por medio de la regresión lineal. Cuando hacemos esto, obtenemos los coeficientes de regresión en forma del corte de la recta y su pendiente.

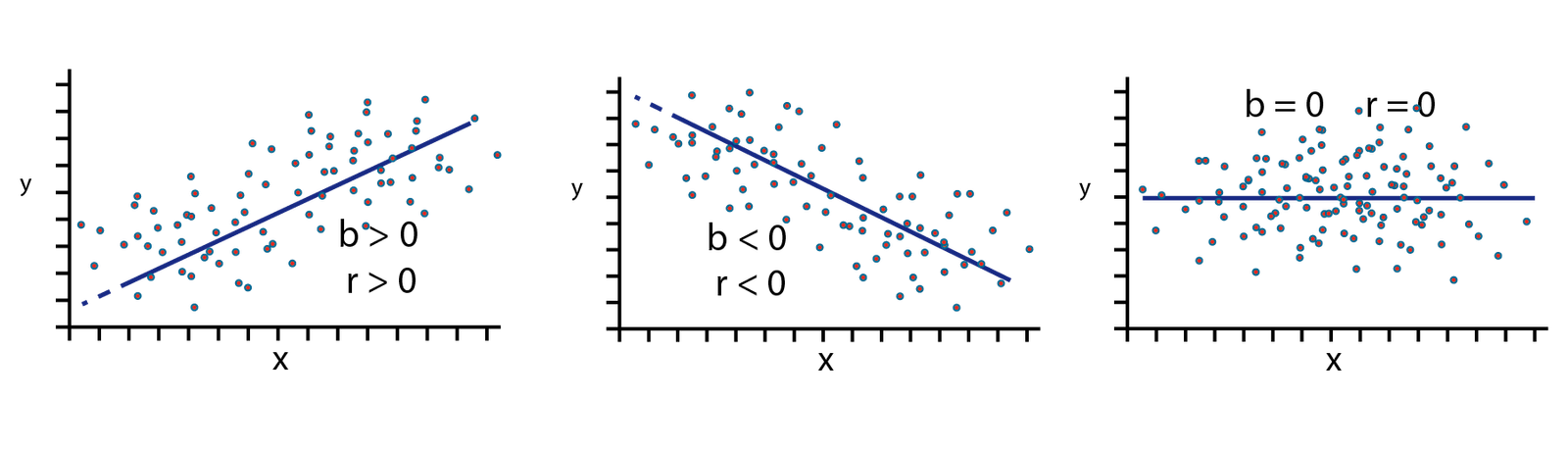

Si observamos muchos ejemplos de cálculos de coeficientes de regresión lineal y de la pendiente de la recta obtenida por regresión lineal, notaremos rápidamente que existe una relación entre ambos valores. En particular, notaremos que siempre que la pendiente es negativa, el coeficiente de regresión también es negativo; cuando es positiva el coeficiente también es positivo y cuando la pendiente es nula, también lo es el coeficiente de regresión.

En las siguientes secciones exploraremos por qué sucede esto y cuál es la relación real entre estos dos valores estadísticos que casi siempre van de la mano.

La correlación y la regresión en estadística y en ciencias

Los estudios de correlación proporcionan una serie de estadísticas tales como los coeficientes de correlación y de determinación, que permiten establecer qué tan correlacionadas están dos o más variables entre sí. En otras palabras, permiten establecer qué proporción de la variabilidad de una variable aleatoria (por lo general cuantitativa) puede explicarse en función de la variabilidad de otra variable aleatoria, en lugar de explicarse en función de variaciones aleatorias propias. Esto quiere decir que permiten establecer qué tan bien explica la variación de una o más variables la variación de otra.

Cabe destacar que los estudios de correlación solo ven eso, la correlación entre dos o más variables, mas no proporcionan evidencia directa de causa y efecto (es decir, no permiten establecer cuál de las dos variables causa la variación de la otra).

Por otro lado, cuando sabemos (por medio de un estudio de correlación) o intuimos que dos variables están correlacionadas de algún modo, por lo general buscamos establecer un modelo matemático que permita representar el comportamiento general de una variable en función de la otra, permitiendo así predecir el valor de una de las variables en función del valor de la otra. Esto se logra gracias a un proceso de regresión mediante el cual se calculan los coeficientes de un modelo matemático que minimizan las diferencias entre los datos observados (los pares ordenados o datos emparejados) y los valores predichos por el modelo.

La correlación lineal y el coeficiente de correlación de Pearson

El caso más sencillo de correlación es la correlación lineal. Esta se da cuando existe una relación lineal entre dos variables cuantitativas de tal manera que, cuando una de ellas aumenta, la otra o bien aumenta siempre en la misma proporción, o bien disminuye siempre en la misma proporción.

Los estudios de correlación lineal se basan en el cálculo del coeficiente de correlación lineal para la serie de datos. Existen varios coeficientes de correlación lineal diferentes que se pueden calcular, entre los cuales los más comunes son:

- El coeficiente de correlación lineal de Pearson

- La correlación lineal de Spearman

- La correlación de Kendall

De los tres, el más simple y además el más utilizado es el coeficiente de correlación lineal de Pearson. Este se puede utilizar cuando los datos emparejados cumplen con las siguientes condiciones:

- La relación entre las variables es lineal.

- Ambas variables son cuantitativas.

- Ambas variables siguen una distribución normal (aunque algunos autores sostienen que se puede utilizar la correlación de Pearson incluso si las variables no se ajustan perfectamente a una campana de Gauss).

- La varianza de la variable que se toma como variable dependiente (la que representamos en el eje Y) es constante para los diferentes valores de la variable independiente (la del eje X).

Si se cumplen estas condiciones, podemos calcular el coeficiente de correlación de Pearson para determinar qué tan buena es la correlación lineal entre ambas variables.

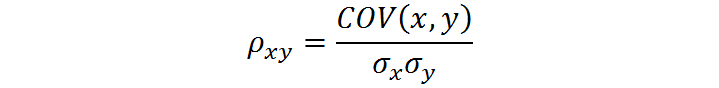

Si conocemos las varianzas de ambas variables (s2x y s2y) y la covarianza (Covx,y o sxy), podemos calcular el coeficiente de Pearson para la población (ρxy) por medio de la siguiente fórmula:

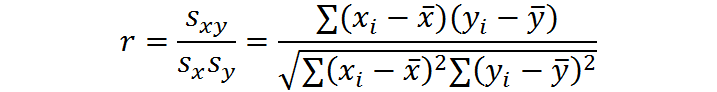

Por otro lado, lo más común es que no conozcamos todos los datos de la población, sino que solo tengamos una muestra. En este caso, lo podemos calcular el coeficiente de correlación de Pearson muestral, que es un estimador del poblacional. Se calcula por medio de la siguiente fórmula:

Donde r es el coeficiente de correlación, x̅ es la media muestral de la variable x, y̅ es la media muestral de la variable y, y xi e yi son los valores individuales de cada una de las dos variables.

Ajuste de regresión lineal por mínimos cuadrados

La regresión lineal es el proceso de ajuste de una serie de datos emparejados a una línea recta. Implica la obtención de la ecuación matemática de la recta que mejor se ajusta a la serie de datos y que, por lo tanto, minimiza la distancia promedio entre todos los puntos y la recta cuando ambos se representan en un sistema de coordenadas cartesianas.

La regresión lineal casi siempre se lleva a cabo por el método de mínimos cuadrados y el resultado es la obtención de los dos parámetros que definen a una recta, a saber, el corte con el eje Y y la pendiente.

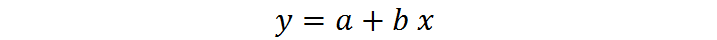

Independientemente de que una serie de datos se comporte o no de manera lineal, siempre es posible obtener la ecuación de la recta que mejor se le ajuste. Si consideramos una variable que tomamos como independiente, X, y otra que tomamos como variable dependiente, Y, la ecuación de la recta viene dada por:

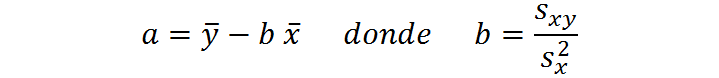

En esta ecuación, los coeficientes a y b son los coeficientes de regresión lineal y representan, respectivamente, el corte con el eje Y y la pendiente de la recta. Se puede demostrar fácilmente que los coeficientes que minimizan el cuadrado del error de la predicción del modelo (la diferencia entre el valor real y el valor estimado por el modelo) vienen dados por:

La relación entre la pendiente de la línea de regresión lineal, b, y el coeficiente de correlación, r

Ahora que tenemos más claridad sobre qué son los coeficientes de regresión lineal a y b y qué es el coeficiente de correlación lineal de Pearson, r, estamos preparados para entender por qué y cómo se relaciona la pendiente b con r.

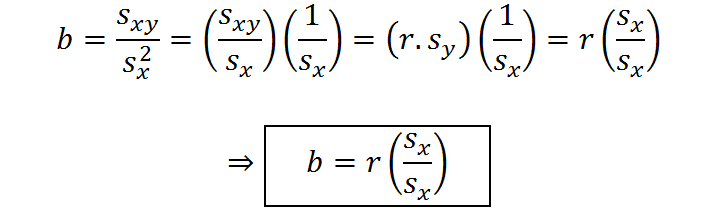

De hecho, la combinación de la ecuación anterior para b y la definición del coeficiente de Pearson, da como resultado la relación matemática entre estos dos estadísticos, para el caso de una muestra de datos:

Como se puede ver, dado que las desviaciones estándar muestrales sx y sy son, por definición, positivas (ya que son la raíz cuadrada positiva de las respectivas varianzas), su cociente será necesariamente positivo. Por esta razón, el signo de la pendiente, b, queda determinado por el signo del coeficiente de correlación, r y viceversa.

Además, dado que la pendiente se expresa como el producto entre r y el mencionado cociente entre las dos desviaciones estándar, en los casos en los que las dos variables no muestran correlación alguna (es decir, cuando se verifica que r = 0), entonces la pendiente de la recta ajustada por regresión lineal a los datos también será nula, como observamos anteriormente.

Esto tiene mucho sentido, ya que, de mantenerse todos los demás factores que afectan a la variable dependiente, si no existe correlación alguna entre esta y la variable independiente, es de esperarse que un cambio en la independiente (es decir, en x) no producirá ningún cambio observable en la primera (es decir, en y). En consecuencia, al movernos de izquierda a derecha a lo largo de la gráfica, no observaremos ningún aumento o disminución en los valores de y, y cualquier variación que podamos observar es debida exclusivamente a la naturaleza aleatoria de dicha variable.

Relación entre el coeficiente de Pearson y la pendiente en el caso de datos poblacionales

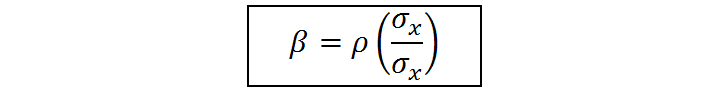

Lo que se acaba de decir en relación a los datos muestrales, aplica de igual manera en el caso de poseer todos los datos de una población. Lo único que cambia es que, en lugar de estadísticos (a, b y r), en el caso de la población estamos en presencia de parámetros.

Como es común en estadística, los parámetros se suelen representar con las mismas letras que los estadísticos, solo que utilizando las letras del alfabeto griego. Por esta razón, el corte y la pendiente de la recta ajustada a todos los datos poblacionales se representan con las letras α y β (en lugar de a y b), y el coeficiente de Pearson se representa con la letra ρ (en lugar de r), mientras que las desviaciones estándar poblacionales se representan con la letra s (en lugar de s).

Así, la relación entre la pendiente y el coeficiente de correlación lineal para la población, viene dada por:

Referencias

Carollo Limeres, M. C. (2012). REGRESIÓN LINEAL SIMPLE. Universidad de Santiago de Compostela. http://eio.usc.es/eipc1/BASE/BASEMASTER/FORMULARIOS-PHP-DPTO/MATERIALES/Mat_50140116_Regr_%20simple_2011_12.pdf

LesKanaris. (s. f.). ¿Qué son los datos emparejados en las estadísticas? – Consejos – 2022. https://us.leskanaris.com/7419-paired-data-in-statistics.html

Martínez Vara De Rey, C. C. (s. f.). Análisis de Datos en Psicología II – Coeficiente de Correlación Lineal de Pearson. Universidad de Sevilla. https://personal.us.es/vararey/correlacion-lineal-pearson.pdf

Rodrigo, J. A. (2016, junio). Correlación lineal y Regresión lineal simple. CienciaDeDatos.Net. https://www.cienciadedatos.net/documentos/24_correlacion_y_regresion_lineal

Santos Cuervo, L. (2000). Regresión y correlación. Descartes. http://recursostic.educacion.es/descartes/web/Descartes1/Bach_CNST_1/Variables_estadisticas_bidimensionales_regresion_correlacion/regresi2.htm

Superprof. (2020, 25 mayo). ¿Que es la recta de regresion? | Superprof. Material Didáctico – Superprof. https://www.superprof.es/apuntes/escolar/matematicas/estadistica/disbidimension/recta-de-regresion.html

Ucha, A. P. (2021, 19 febrero). Coeficiente de correlación lineal. Economipedia. https://economipedia.com/definiciones/coeficiente-de-correlacion-lineal.html